各研究テーマの論文は研究業績ページに掲載されています.

また,ここには掲載されていない過去の研究などの動画は,本研究室のYouTubeチャンネルをご覧下さい

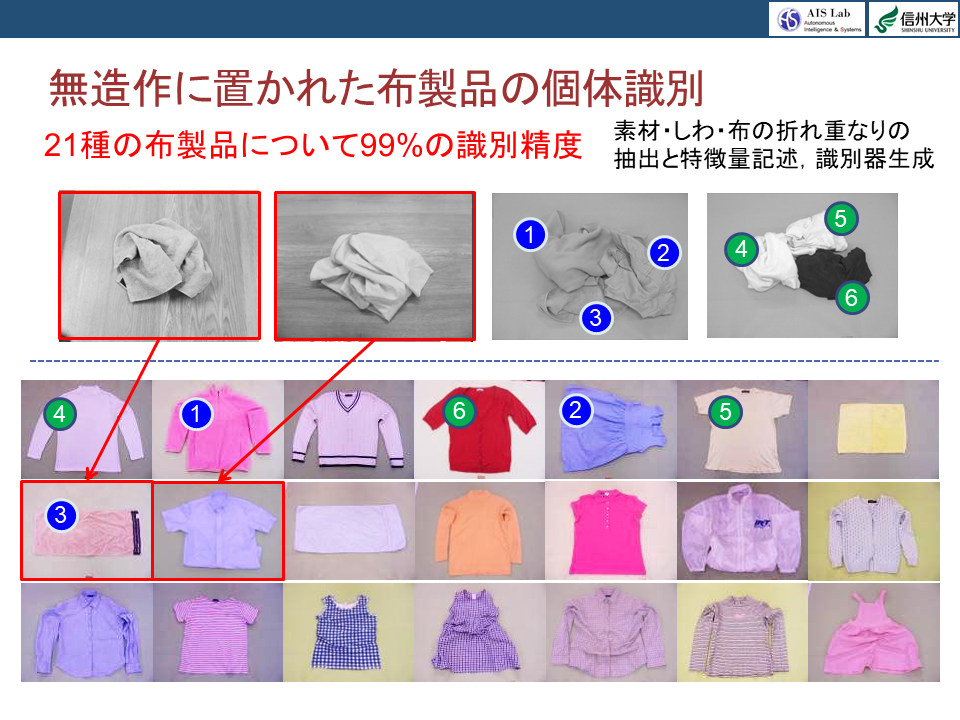

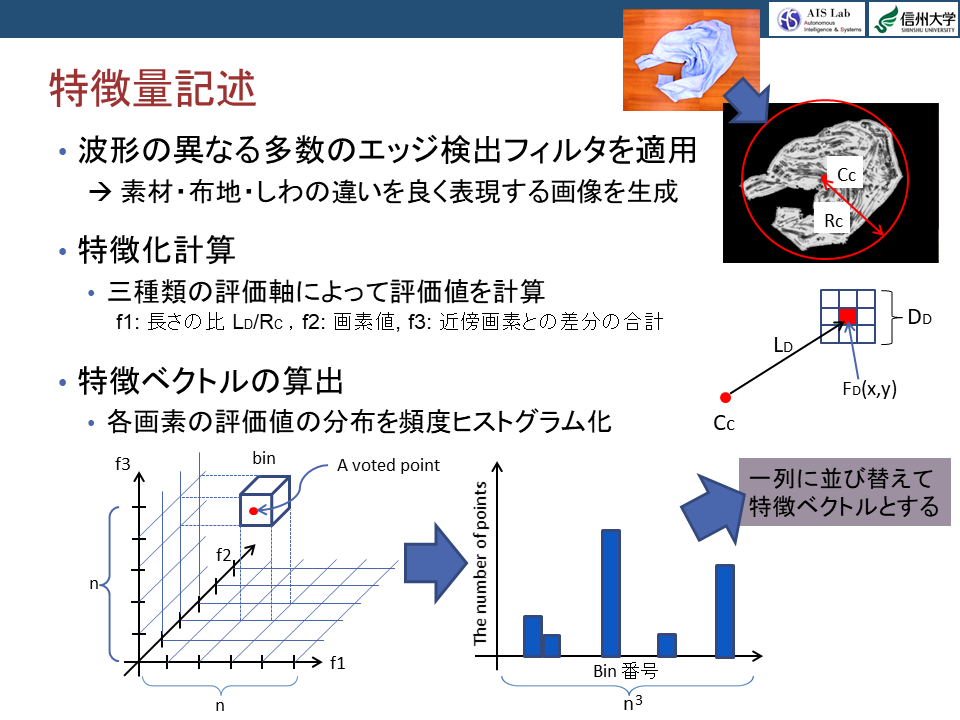

布製品の識別

無造作に置かれた布製品の画像から,それがデータベースにあるどの布製品であるかを見分ける手法を提案しました.この手法の特徴は,布地のシワや折れ重なりに着目した特徴量を算出することで,置かれている布の形によらず高い識別率を達成できるところです.検証実験では,21種類の布製品に対して99%の識別率を達成しました.また,複数の布製品がまとめておかれている場合にも,個々の布製品の存在領域と個体識別をすることができます.

(業績リンク:SICE論文集2013, SI 2011)

物理シミュレーションを用いた布製品折り畳み方法の獲得

布製品を正確に折りたたむために,適切な把持位置および折り畳み軌道を生成する方法を研究しました.この研究では,物理シミュレーションを利用して様々な布の畳み方を試します.このとき,折り畳み後に布製品のフチが揃っているかだけでなく,不要な折れが生じていないか,折り畳み中に布がテーブル上で滑っていないかなども勘案して,畳み方を評価します.そして,その評価に基づいて適切な畳み方を探索する処理では,ベイズ最適化を利用しました.それにより,少ない試行回数で良好な畳み方を獲得することができました.タオル,Tシャツ,ズボンの3種類の布製品を用いて,実際のロボットで正確な折り畳みが実行できることを確認しました.

(業績リンク:SICE中部支部シンポジウム 2018,ICMA 2019)

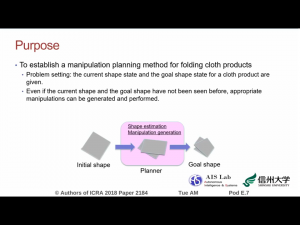

形状変化予測に基づく布製品の折り畳み

布製品の初期形状と目標形状を与えると,その間をつなぐための操作と,布製品の中間的な形状を同時に出力する方法です.これを実現するため,ある操作を加えたときに,布がどのように変形するかを予測する仕組みを提案しました.また,その仕組みを利用して,ある形状変化を実現するために加えるべき操作を自動で生成できるようにしました.この仕組みは,布製品の形状が初見であったり,目標形状を達成するために複数回の操作が必要な場合でも機能します.双腕ロボットで矩形の布生地を折りたたむ作業に適用し,提案手法の有効性を確認しました.

(業績リンク:ICRA 2018, 日本機械学会論文集 2018, ロボシン 2018)

双腕ロボットによる矩形布生地の展開動作

単腕ロボットにより布生地をテーブル上に広げることを目指した研究です.単腕は双腕と比べると操作能力が低いので,布のような柔らかい物体を所望の形へ変形させることは一般的に困難です.この研究では,単腕でテーブル上に布を広げるための手順を新たに提案しました.まず,深度画像から布の角を検出し,把持して持ち上げます.そして,広げやすい形であるかを判定し,広げやすい形になるように布を振る動作をおこないます.その後,テーブルの角部に布生地を当てながら引っ張ることで,テーブル上に平らに広げます.このとき布の挙動が安定するように,テーブル角部に設置する器具も提案しました(特許出願済).

(業績リンク:信州ロボット研究会 2015)

双腕ロボットを用いた風呂敷包装

柔軟物操作の一環として,風呂敷によるラッピング作業をおこないました.風呂敷の中央に置かれた長方形の箱を対象とし,シワなく包むための手順・布の軌道生成手法・布の認識手法を提案・実装しました.このような作業は,片方の手だけでやろうとしてもうまく包むことができません.もう片方の手で布を抑えるなどの補助動作が必要になります.本研究では,把持点や押さえ点,さらには折り目の位置も画像処理により自動で検出しています.また,布をかぶせるときの手先の軌道についても,物理シミュレーションを用いて適切な解を探索しました.そして,双腕ロボットを使用して包み作業を実現しました.

(業績リンク:信州ロボット研究会 2018)

人型ロボットの身体部分を用いた布製品の折り畳み作業

Tシャツなどの布製品を,胸部に当てながら畳む方法に関する研究です.この畳み方は,人が布製品を畳む際によくおこなう方法の一つであり,作業スペースが少なくて済むこと,布の形状変化の予測が容易であることなどの利点があります.本研究では,人が布製品を折り畳む作業を実演し,それをロボットに観察させて,自動で折り畳みの能力を獲得させるアプローチを採りました.提案手法は,人の作業を自動的に分割する工程と,分割した各作業での動作を獲得させる工程から成ります.この動画では,人による折り畳み動作と,ロボットが獲得した折り畳み動作をそれぞれ示しています.

(業績リンク:JRSJ 2019, ロボシン 2019, ICIA 2018)

教示者の見立てに基づく道具操作軌道の生成獲得

家庭内で道具を操作して作業するロボットへ,傍にいる人が直感的に,より良い操作を教えてやることのできる学習システムの研究を行っています.本研究では,人がロボットへ操作を見せて教える際に,人が古来より情報伝達に用いてきた,ある事物に他の事物の像を重ねて表現する「見立て」の技法を使用できる学習システムを目指しています.見立てを用いた教示を検知する機構や,人とロボットの手元の操作量を対応付ける機構の開発により,人とロボットの手元の環境や道具が異なっていても,人が自らの手元をロボットの手元に見立てて教示すると,ロボット自身が見立て方を解釈し,より良い操作を学べるようになってきました.

(業績リンク:robomech 2018,ROBIO 2018)

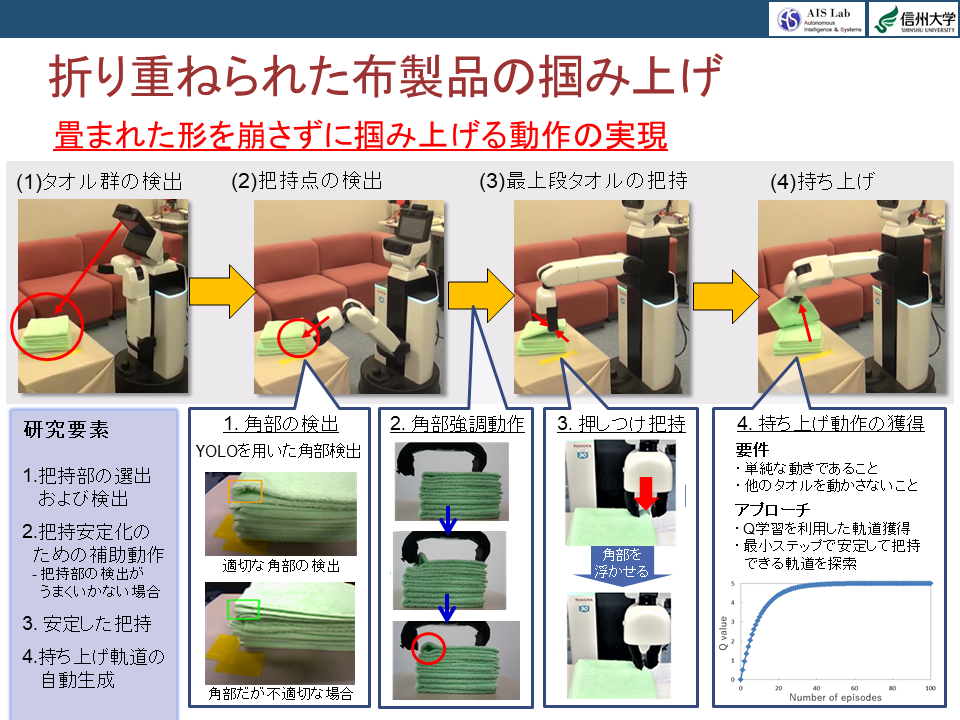

折り重ねられた布製品の掴み上げ

私たちは普段タオルなどの柔軟物を毎日のように扱っています.本研究では折り畳まれ積み重なったタオルのうち一枚を掴み上げる作業に着目し,生活支援ロボットHSRを用いて実現しました.ポイントは適切な箇所を掴むことでタオルの形状を崩さずに掴み上げることです.掴み上げのアプローチとして,YOLOを用いた認識による方法と強化学習を用いた方法を提案し,実機実験により有効性を検証しました.

(業績リンク:SI 2017)

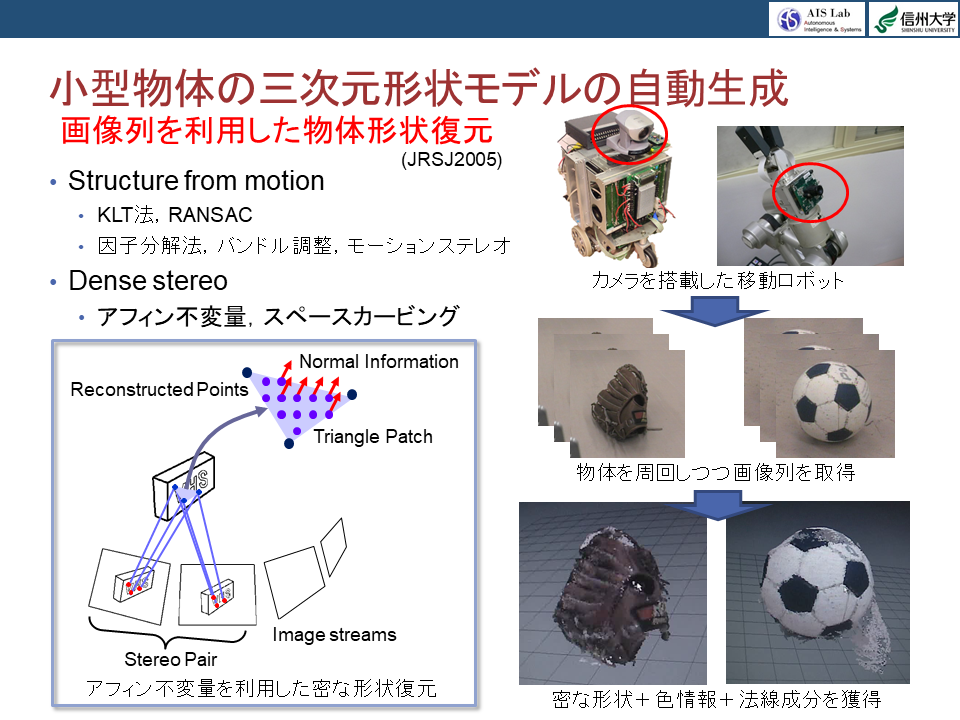

小型物体の三次元形状モデルの自動生成

ロボットに搭載したカメラを能動的に動かしながら対象物を撮影し,その画像列から物体の三次元形状モデルを取得する方法を研究しました.Structure from Motion(SfM)により疎な形状復元をおこなったのち,アフィン不変量を利用した密な近似形状を復元する流れを提案しました.車輪型移動ロボットやロボットアームの手首部分に搭載したカメラでモデルが取得できることを確認しました(筑波大学知能ロボット研究室での研究成果).

(業績リンク:JRSJ 2005, ICRA 2004)

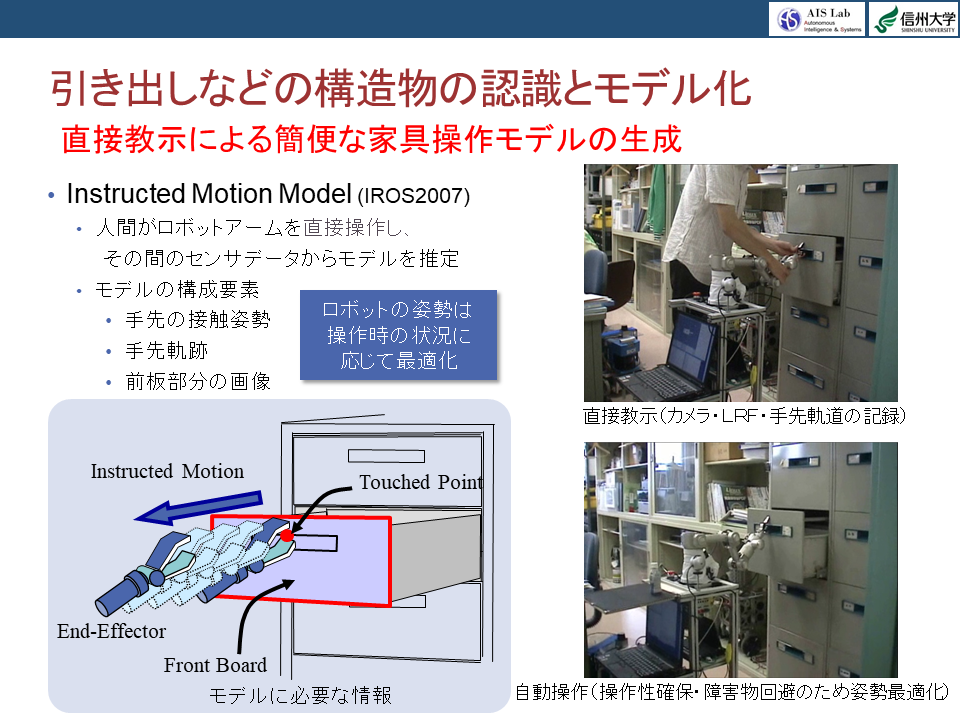

可動構造のある物品のモデル化

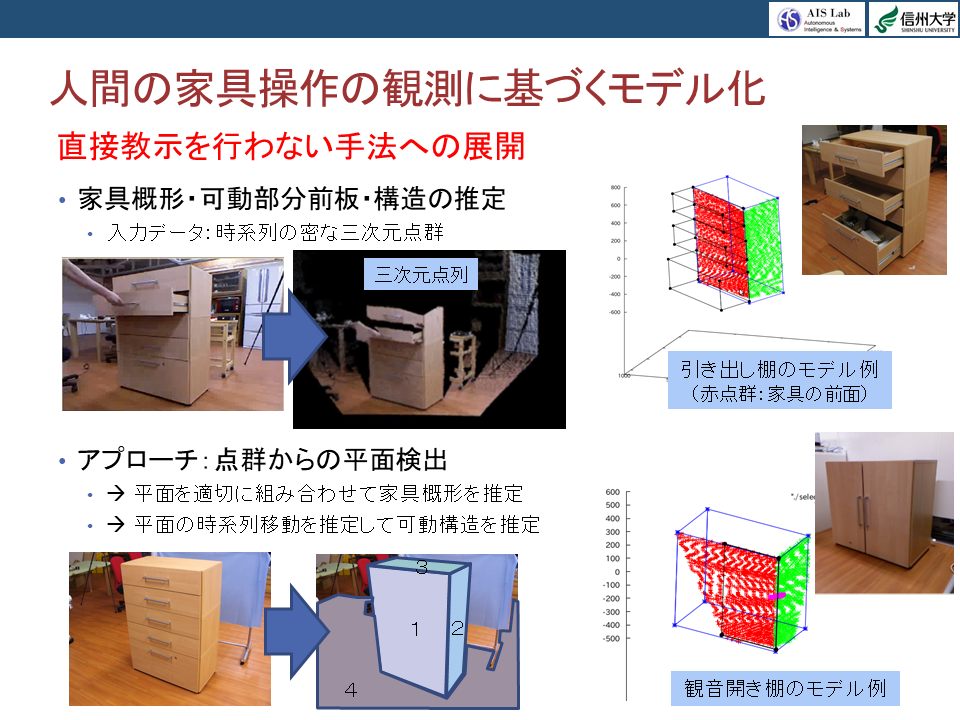

引き出しや扉などの構造物には,可動構造があります.ロボットがそれらを操作して有益な仕事をおこなうには,その構造を適切にモデル化し,操作できるようになることが望まれます.そこで,人間がロボットを直接動かして家具を操作させたり,人間が家具を操作している様子をロボットに見せるなどして,家具の構造および認識に必要な特徴を得る方法を研究しました(筑波大学知能ロボット研究室および東京大学情報システム工学研究室での研究成果).

(業績リンク:robomech 2007, IROS 2007, CASE 2014)

三次元形状情報に基づく物品のカテゴリ識別

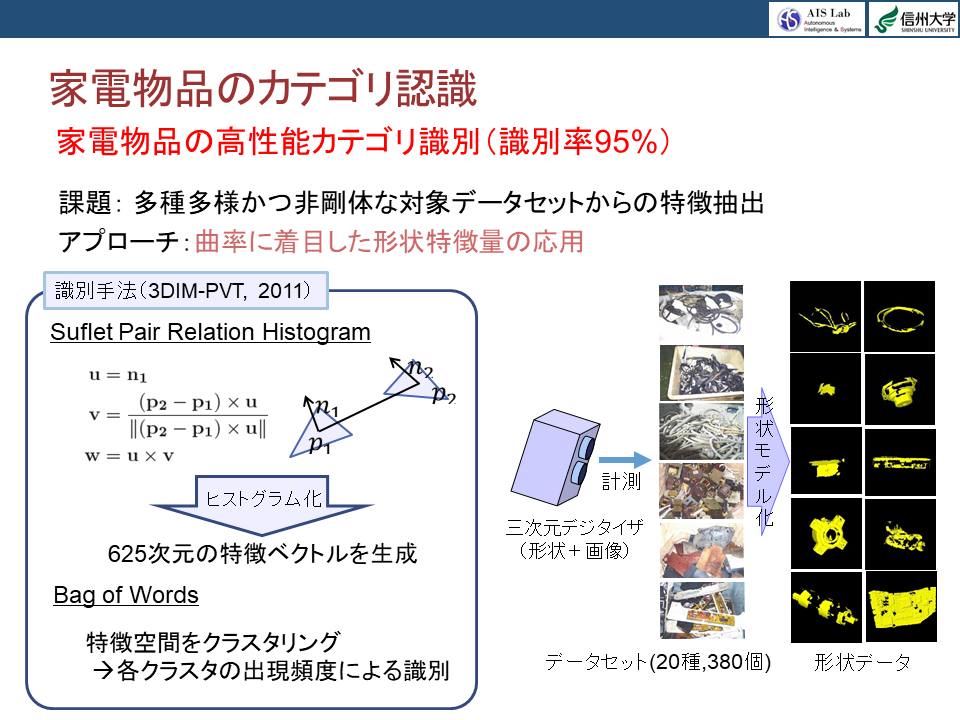

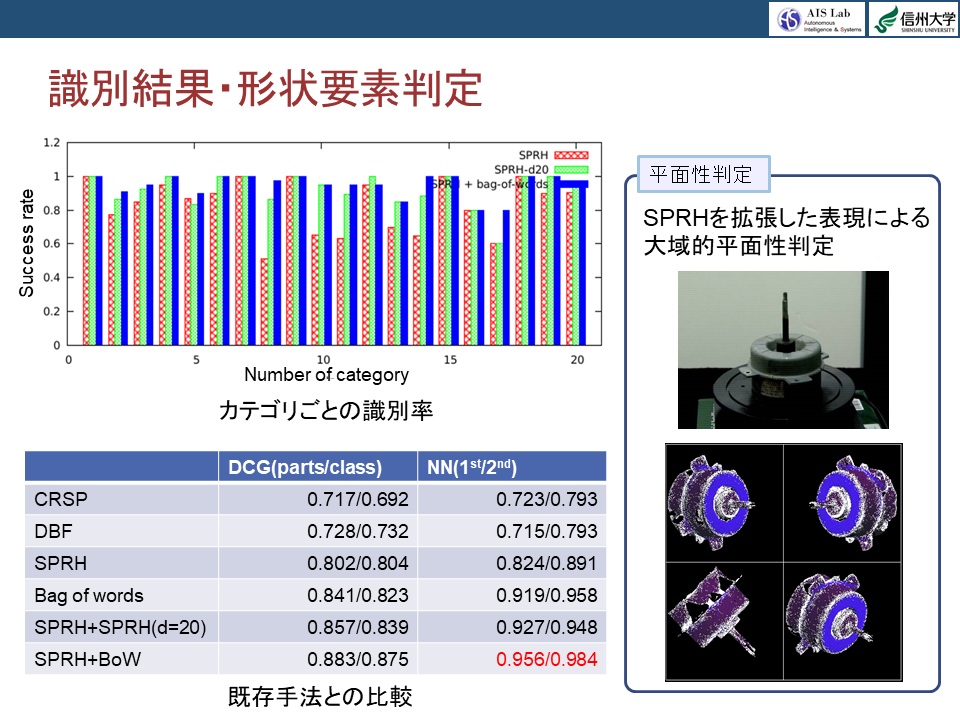

三次元デジタイザで計測して得た三次元点群を入力として,物品のカテゴリ認識をおこなう手法を提案しました.ここで対象とした物品群は,家電製品の中に組み込まれているような電子部品やケーブルを含みます.見た目や形状に多様性がある中で適切な識別結果を得るために,SPRHを中核とする識別アルゴリズムを提案し,識別率95%以上の性能を得ました(東京大学情報システム工学研究室での研究成果).

(業績リンク:3DIM-PVT 2011)

生活支援ロボットを利用したドア形状と操作モデルの推定

生活支援ロボットをタブレット端末などから簡単に動かし,家具を操作させたり,物を持ってこさせたりするための,半自律知能の開発をおこなっています.本研究では,手元の端末に表示されたロボットの視野画像を使い,取っ手の位置をクリックあるいはタッチするだけで,ロボットが扉を開けることのできる技術を開発しました.ロボットが視覚情報と力覚情報を併用して,引き出しか,右ヒンジか,左ヒンジかといった扉の操作方法を自律推定することで,初めて見る扉の操作も可能となりました.

(業績リンク:IROS 2018)

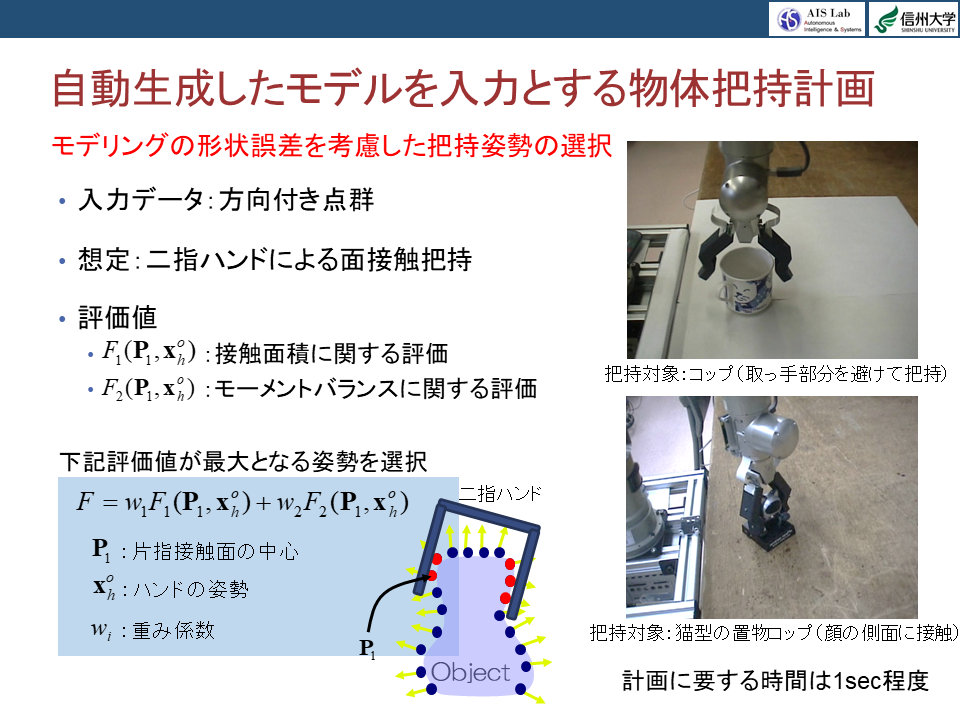

自動生成モデルを入力とした物体把持計画

把持計画手法の多くは,把持対象物の幾何学的な形状を入力とします.しかしながら,そのような事前情報を正確に与えられない場合には,ロボット自身が認識した形状情報に基づいて,把持の仕方を決めなければいけません.それを実現する方法として,三次元点群を入力とした把持計画手法を提案しました.提案手法は,把持の安定性に関するいくつかの評価値に基づいて,もっともよい把持方法を選択することができます(筑波大学知能ロボット研究室での研究成果).

(業績リンク:ICRA 2006)

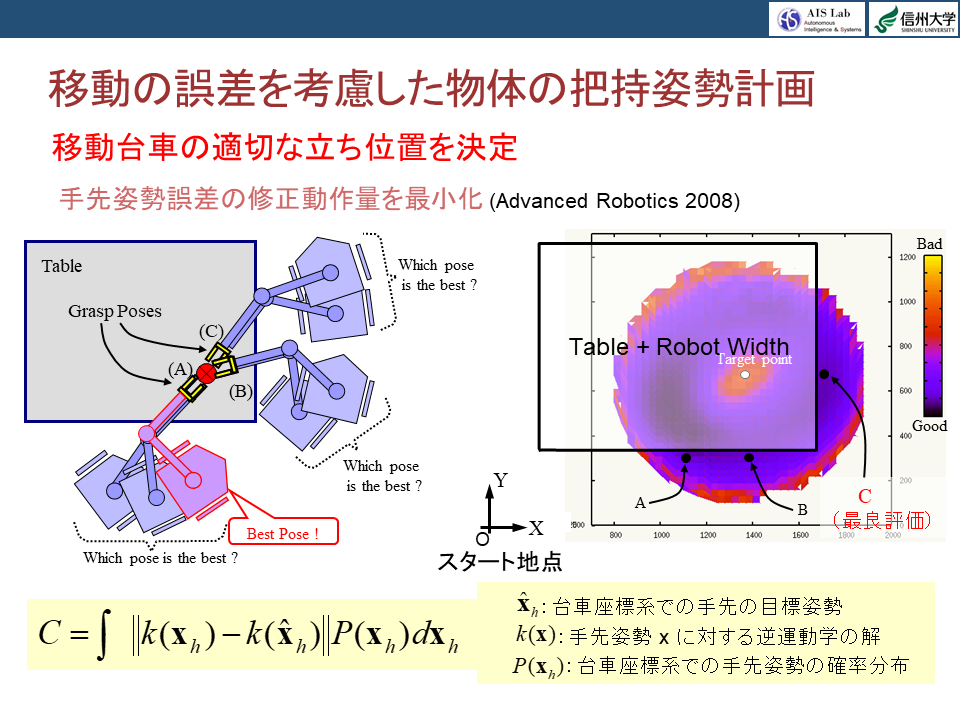

移動マニピュレータの立ち位置計画

移動マニピュレータは,移動能力と物体操作能力を持ち合わせたロボットです.その動き自由度の高さゆえに,例えば机の上の物品を掴もうとするとき,マニピュレータの関節角度だけでなく移動台車をどの位置に停めるかも決める必要があります.この研究では,移動後に手先に入りうる誤差を見積もり,それを修正する量が少ないことを基準とした立ち位置探索法を提案しました.検証実験では,単に台車の移動距離が小ければよいわけではないことを示しました.

(業績リンク:Advanced Robotics 2008, ROBIO 2006)

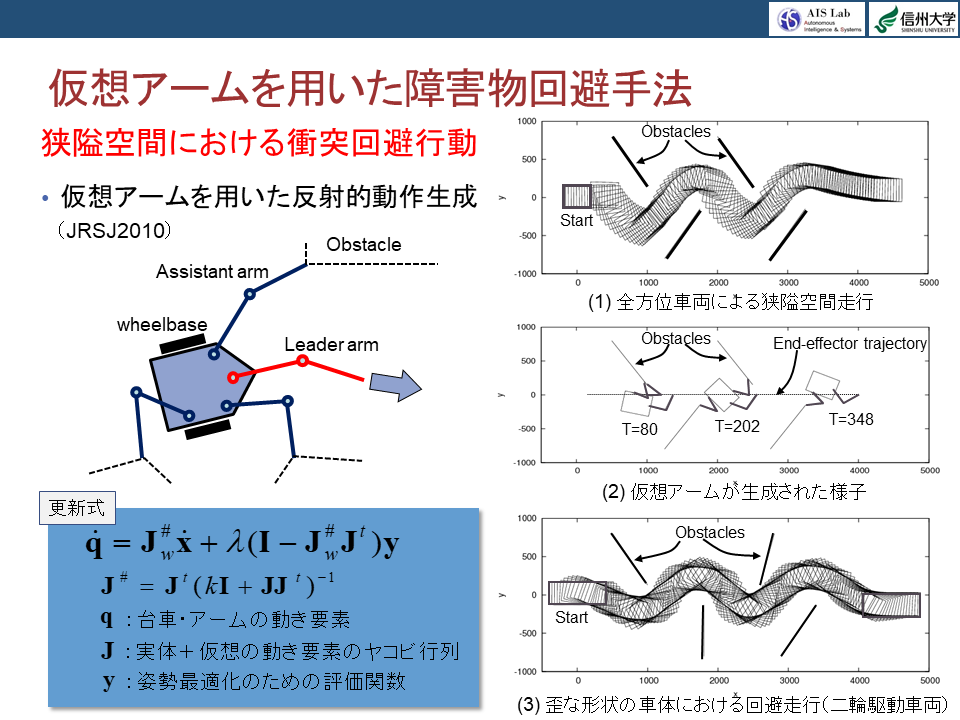

仮想アームを用いた障害物回避

ロボットが周囲の障害物に干渉せずに動くには,障害物を検知したのちに,それを避ける動作を生成する必要があります.この研究では,仮想アームの概念を導入した反射的な動作生成の手法を提案しました.複数の仮想アームと移動台車の動き要素を一つのヤコビ行列で表現し,それを用いて移動台車の速度・角速度を決定します.移動台車の動き自由度が変わっても,計算量はほとんど変化しないなどの利点があります.

(業績リンク:IROS 2009, JRSJ 2011)

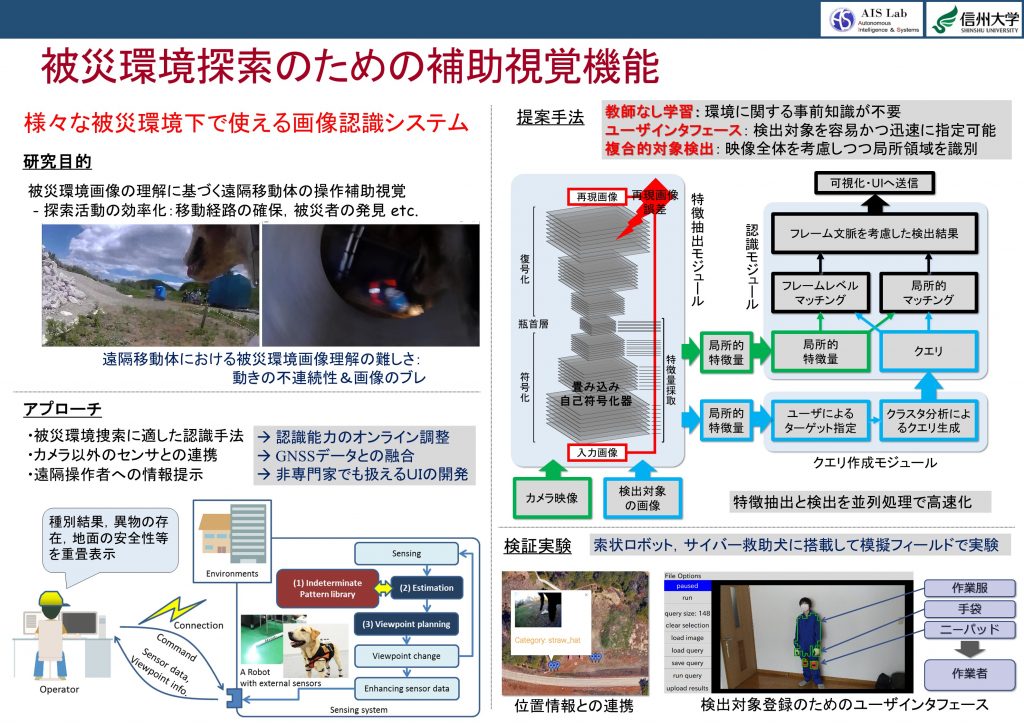

被災環境探索のための補助視覚機能

被災地で捜索活動をおこなうにあたり,遠隔操作型ロボットなどの移動体を利用する方法があります.当研究室では,そのような遠隔移動体に搭載することを想定した画像認識システムの研究開発をおこないました.被災環境は多様である一方,捜索活動には高い迅速性が求められます.そこで私たちは,映像から認識能力を得る処理(学習処理)を効率化することで、少ない事前情報から画像認識器を作り出す技術を開発しました.そして,サイバー救助犬や索状ロボットにその技術を搭載し,効果を確かめました.

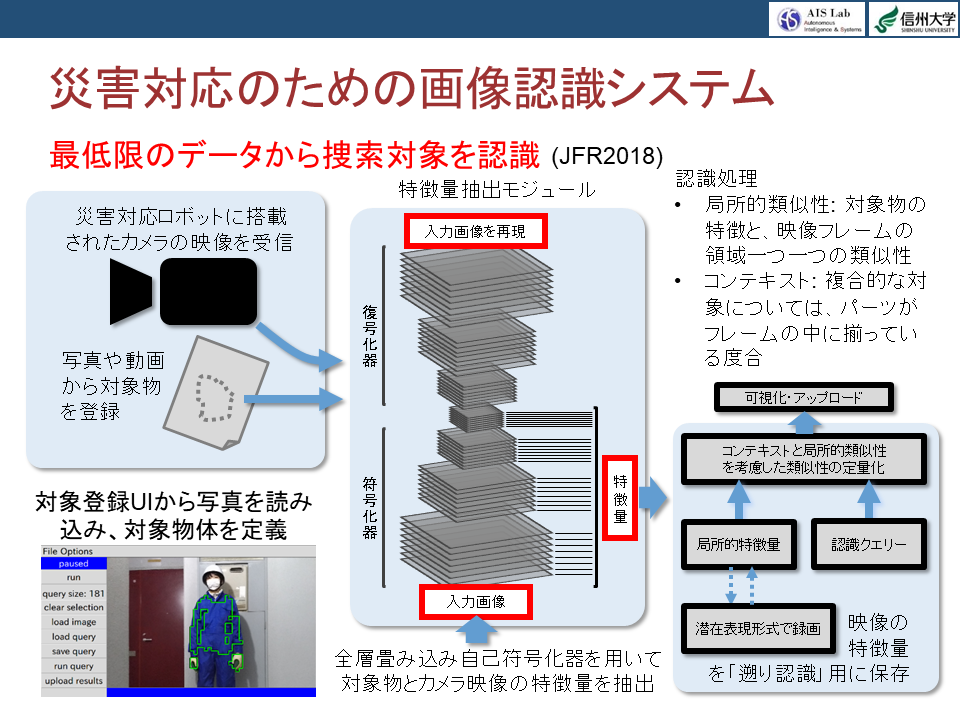

災害対応のための画像認識システム

災害対応においてロボットの活躍が期待されています.この研究では,災害ロボットによる捜索活動をサポートする画像認識システムを開発しました.既存の画像認識技術の災害対応への応用には様々なハードルがあります.その一つとして,画像認識システムの学習に必要なデータ量が挙げられます.いつ,どこに災害が起きるのが分からないため,適切なデータを事前に用意することが困難です.しかも,災害が起きてから直ちに利用できることが重要です.この問題に着目し、認識対象がその場で初めて定義されても利用できる手法を追究しました。全層畳み込み自己符号化器を用いて、画像(対象物とカメラ映像)の特徴を抽出します。この特徴抽出機能を認識対象知らずに、教師なし学習で事前に獲得します。そして作動時に、対象物とカメラ映像の特徴の類似性を用いて認識処理を行います。局所的類似性とフレーム全体のコンテキストを両方考慮した処理を取り入れています。対象物登録用のUIにも、特徴量を活かして登録作業を簡略化しています。尚、捜索の最中に新しい捜索対象が追加される場合も考えられます。新しく対象が追加されたとき、そこまでの捜索を振り返って、該当するものがあったかを素早く確認する「遡り認識」を実現しました.

(業績リンク:画像ラボ 2018, ImPACT NEWS LETTER 2017)

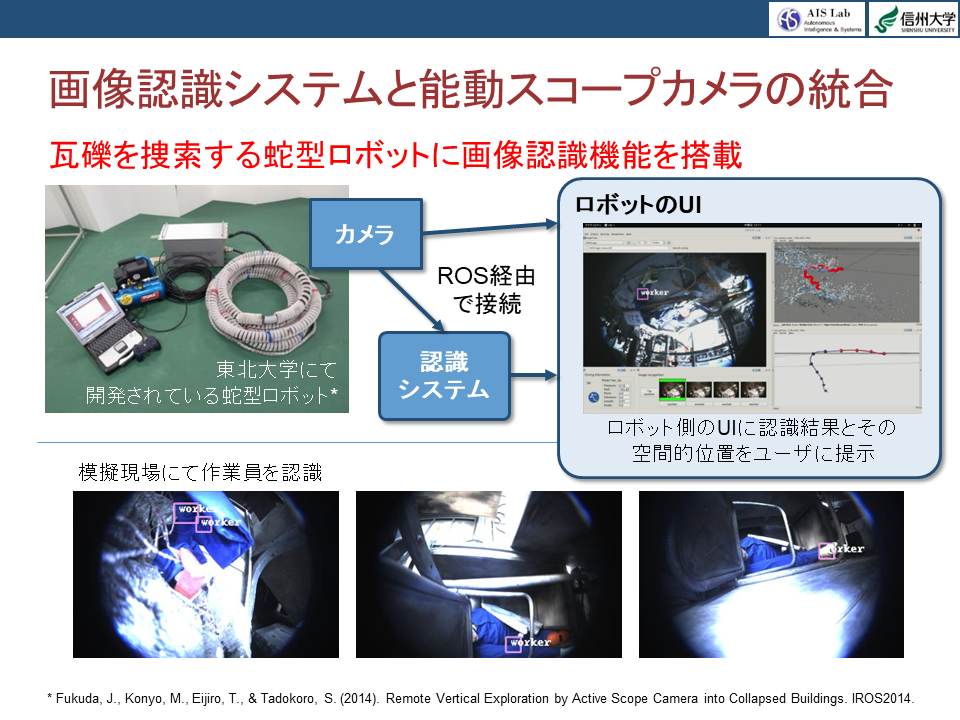

災害対応のための画像認識システムを,東北大学にて開発されている「能動スコープカメラ」と統合しました.「能動スコープカメラ」は体を覆う繊毛の振動や空気浮上で移動する,崩壊した建物や瓦礫の中で被害者等を探すための蛇型ロボットです.ROS(Robot Operating System)を用いて認識システムをこのロボットと統合しました.倒壊したビルに閉じ込められた作業員を発見する課題を設定し,模擬現場にて検証実験を行いました.

(業績リンク:robomech 2017)

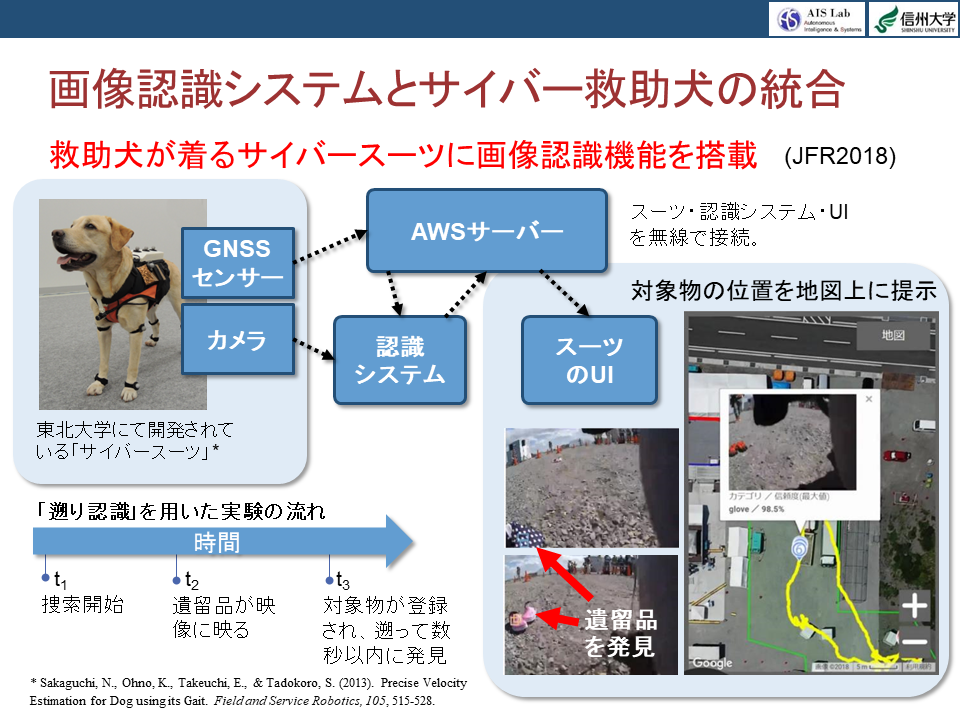

災害対応のための画像認識システムを,東北大学にて開発されているCyber-Enhanced Rescue Canine (CRC)と統合しました.CRCは複数のセンシング技術が搭載された,救助犬用のスーツです.スーツからの映像・位置情報(GNSS)をストリーミングとサーバー(AWS)経由で受信し,認識結果をまたサーバー経由でスーツのUIと共有します.スーツのUIでは認識結果が表示され,地図上にその位置もマークされます.行方不明者の遺留品を発見する課題を設定し,模擬現場にて遡り認識を用いた検証実験を行いました.尚,兵庫県立三木総合防災公園の瓦礫フィールドにてデータ収集を行い,このデータを用いて小規模の定量的評価を行いました.

(業績リンク:robomech 2017)

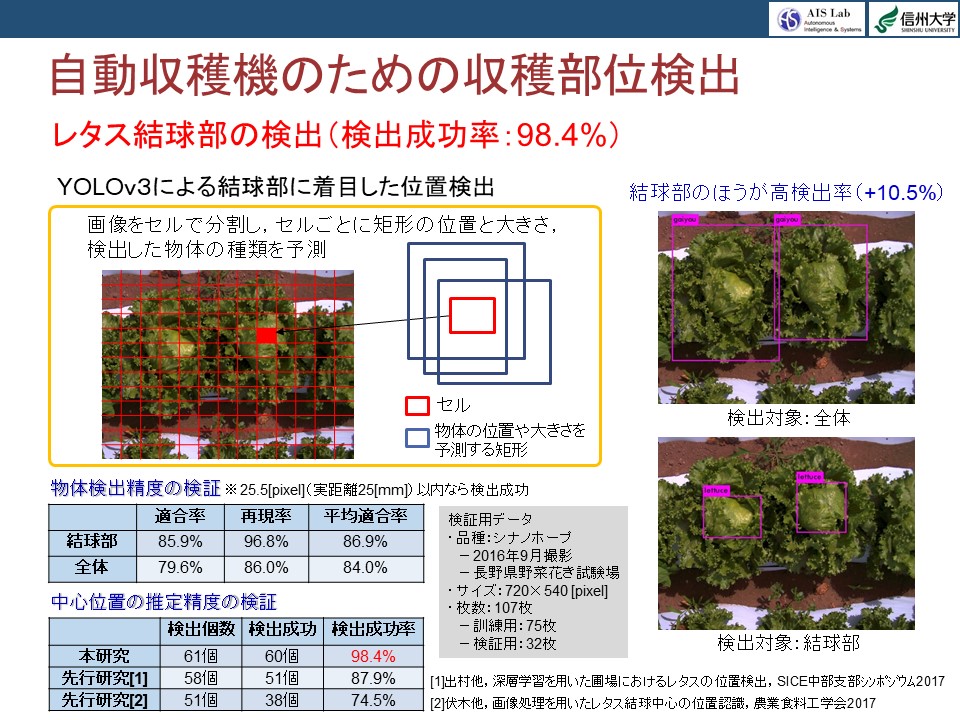

結球型野菜自動収穫期のための収穫物検出

レタスの収穫作業の自動化を目指した研究です(信州大学工学部千田研究室との共同研究).自動化を実現するためには,畑に植えられているレタスの刈り取る位置がどこにあるのかを,収穫装置に教える必要があります.この研究では,高速かつ高精度な物体検出手法の一つであるYOLOv3を利用して,レタスの結球位置を検出しました.

(業績リンク:SICE中部支部シンポジウム 2018)

パーソナルモビリティの自律機能

屋内外で人を運ぶことができるパーソナルモビリティの研究をおこないました.そのようなモビリティには,人にぶつからないように避けて走ったり,乗りたい人を見つける機能が求められます.この研究では,全方位カメラとレーザ距離計を組み合わせて,人の検出と追跡をおこなう手法を提案しました.また,その応用として,手を振っている人を見つけて近づき,その人を乗せて目的地まで自律走行するデモンストレーションも実現しました(東京大学情報システム工学研究室での研究成果).

(業績リンク:FSR 2012, ROBIO 2010)

自律走行ロボットのための環境マップ

屋外環境で人にサービスをするロボットには,障害物を検知したり,目的地までの経路を決めるなどといった様々な機能が必要とされます.そこで,地図作成,自己位置推定,経路計画,障害物回避,三次元環境認識の各種機能を統合した自律移動システムを構築しました.この動画では,信州大学工学部内を走行している様子を示しています.機械システム工学科南棟から管理棟まで,自律的に走行させることができました.また,このロボットでつくばチャレンジ2014にも参加しました.

(業績リンク:SICE中部支部シンポジウム 2014, つくばチャレンジ 2014)

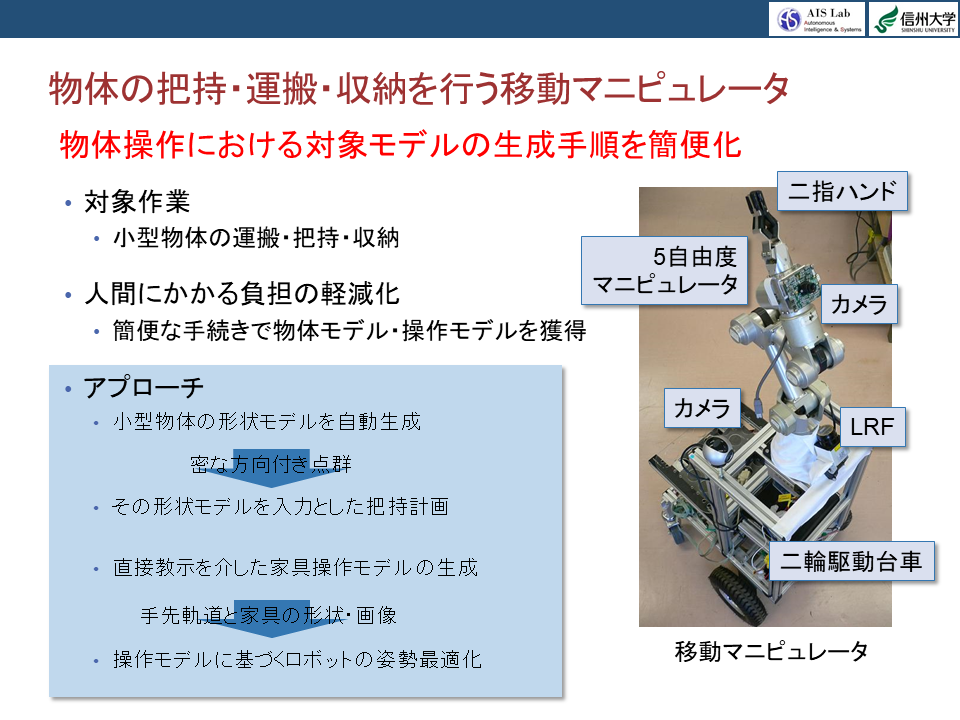

物体の把持・運搬・収納をおこなうロボットシステムの構築

二輪駆動台車の上に一台のマニピュレータを搭載したシステムを構築し,小型物品の把持・運搬・収納をおこなわせました.この研究の特徴は,物品の形状情報をあらかじめ与えなくてもよいところです.すなわち,ロボット自身が物品の形状情報をその場で獲得し,その形状に対する把持計画を実行し,把持するまでをおこないます.さらに,あらかじめ操作方法を教示された家具の中に,運搬した小型物品を収納することも実現しました(筑波大学知能ロボット研究室での研究成果).

(業績リンク:ロボシン 2006, FSR 2007)

移動型双腕ロボットのシステムインテグレーション

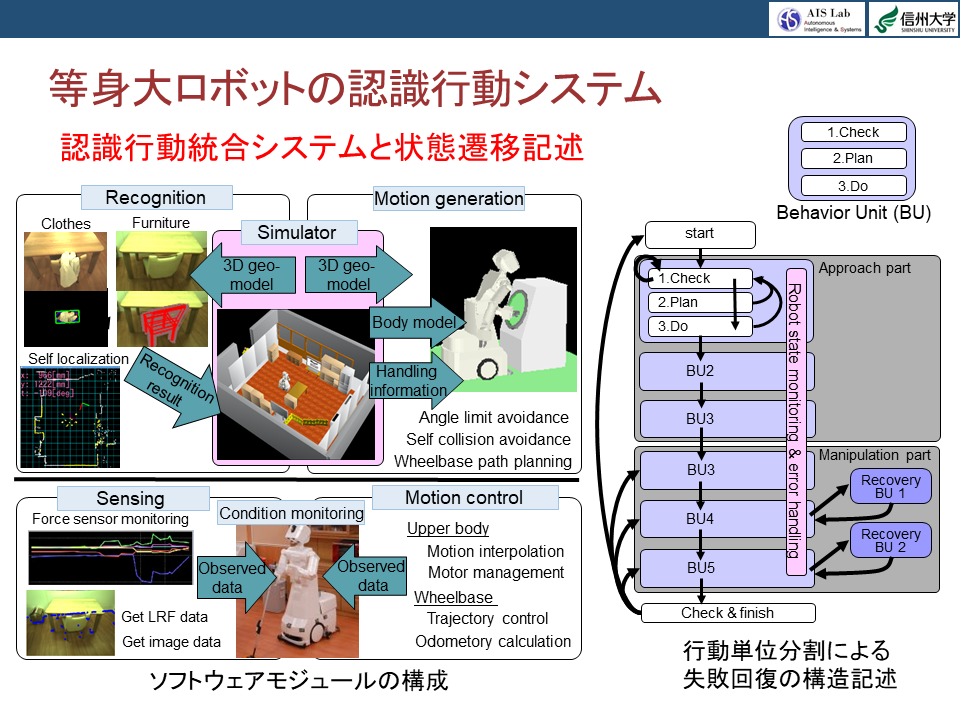

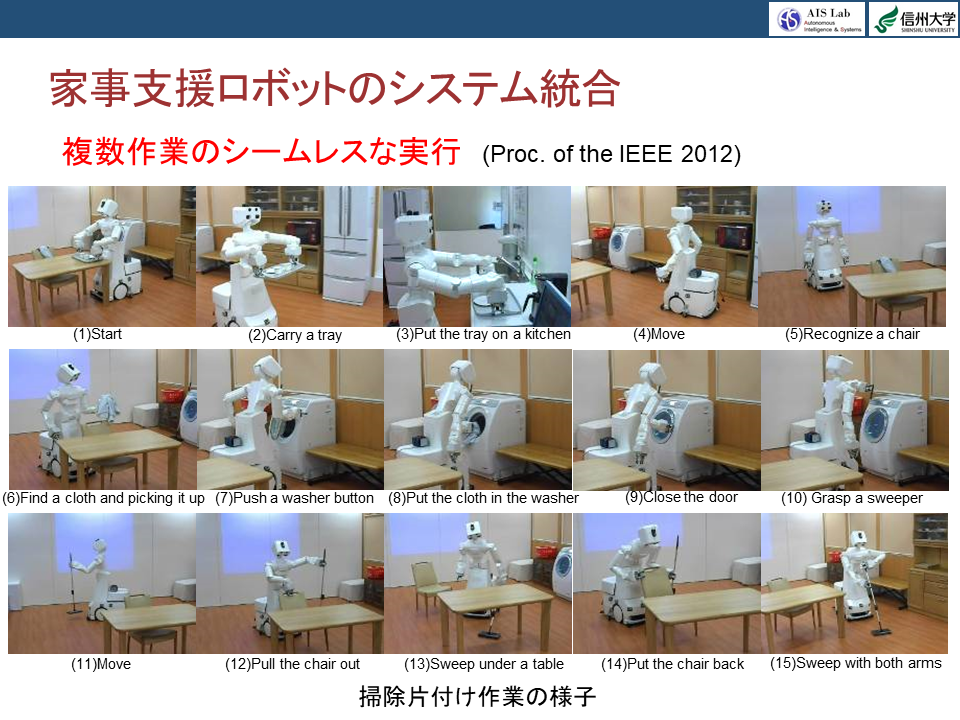

移動能力とマニピュレーション能力を併せ持ち,様々に有益な作業をおこなうロボットシステムを実現しました.物体姿勢推定,事故位置認識,動作計画,タスクプランニングなどの各種要素を実装し,それらを適切に利用してタスクを実行する仕組みを実装しました.さらに,もし作業に失敗した場合にそれを検知し,失敗から回復するための適切な動作を自動で選択する仕組みも構築しました.実験では,一般家庭を模擬した環境においていくつかの物体操作を連続して行うデモンストレーションを実現しました(東京大学情報システム工学研究室での研究成果).

(業績リンク:IROS 2010)